ハイビット、ハイサンプリング [オーディオ]

昨日取り上げましたハイレゾで聴くアナログ録音ですが、人の耳は一般的に 20Hz - 20,000Hz の範囲しか聴くことはできないので、本来はサンプリング周波数を上げても違いが聴き取れるはずはないのですが、実際に聴いてみると、歌い手とマイクの距離、バックとの距離感、といった音場感が確かに違うのです。

そのほかにもスクラッチノイズの音質、そして歌い手の細かなヴィブラートがはっきりと違って聴こえるのです。

それは多分位相などがより正確に再現されることによるのではないかと思いますが、なぜこんなにも違うのかは説明することができません。

大部分の方はハイレゾ(High-Resolution Audio)についてはある程度わかっていらっしゃると思いますが、CD の当初の規格と比較してみます。

CD の規格を決めたのは SONY と PHILIPS でしたが、当初 PHILIPS は量子化ビット数は 14bit で十分と主張しましたが SONY は 16dit を主張し、それが規格となりました。

当時としては 16bit はオーバースペックと考えられていて、家庭用の PCMプロセッサーとして発売された PCM-1 PCM-F1 も基本は 14bit で、16bit も選択できる、という仕様でした。

※ ’16.3.5 追記

PCM-1 は据置型で 13bit。圧縮技術により 14bit 相当、ダイナミックレンジ 85dB。

PCM-F1 はバッテリー駆動のポータブルタイプ。

サンプリング周波数は 44.056kHz。

サンプリング周波数44.1kHzは、一見するとキリの悪い意味のない周波数に見えるが、これはPCMプロセッサーに由来する。すなわちテレビとその映像信号の水平同期周波数15.75kHzの 3×(14/15)倍である。1水平走査内に6標本(ステレオ各チャンネル3標本ずつ)をビデオ信号の形に変調して記録する。PCMプロセッサーで利用したVTRでは、垂直帰線区間をヘリカルスキャン方式の回転ヘッドの切替えタイミングとしており記録に使えないため、その付近の各フィールド毎17.5本(総走査線数の1/15)の走査線の部分を使っていない。

ただし、カラーテレビ放送のNTSCの水平同期周波数は(約)15.734 kHzで、VTRには15.734 kHzのものと15.75 kHzのものが混在していたため、サンプリング周波数も44.056 kHzと44.1 kHzが混在していた時期があった。

(Wikipedia)

今では 16bit でも不足と言われていて、ハイレゾなどのハイビットの録音が受け入れられています。

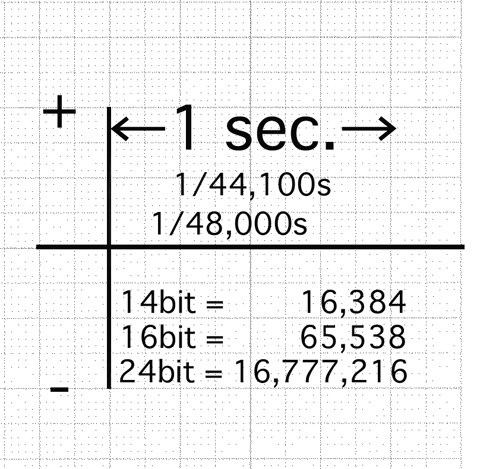

量子化ビット数を増やしていくと同じ波の高さを表すためのその段階が多くなり、方眼紙で言えば 1mm の目盛りが 0.5mm、0.1mm という具合にだんだん細かくなることを意味します。

デジタルの画像と同じで、目盛りが細かい方が精細であるのは当然のことです。

またサンプリング周波数については 20kHz まで録音するためには 44.1kHz が必要とされ、それが規格となっています。

基本的なことですが、サンプリング周波数 44,100Hz というのは1秒間を 44,100にスライスするということで、単純計算では 22,050Hz が記録できることになります。

音の波は単純な正弦波を例にとれば 0 から + に振れて減衰して 0 に戻り、次に - に振れてまた 0 に戻るという一つのサイクルが基本になっていて、1秒間にこれを 20,000回繰り返すのが 20kHz の音です。

これをデジタルで記録するためには + と - それぞれの状態(高さ)を表すことができなければなりませんから、最低でも 40,000回切り取ることが必要です。

なのでサンプリング周波数 48kHz であれば 24kHz まで、 96kHz であれば 48kHz の音まで記録できることになりますが、確かにこんなに高い周波数の音は人の耳では捉えることができないはずです。

+ と - を説明に使いましたが、スピーカーの振動板の動きを例にとれば振動板が + の時は前に出て、 - の時は引っ込み、音がなくなれば中央で止まります。

デジタルでは + はなく、全て - 側で表現されます。

最大レベルが 0dB というのはそういう意味で、これを超えるレベル(音量レベル)は記録することができません。量子化ビット数を増やすということは音の大きさのレベルの違いをきめ細かく表すことができるということでもありますし、ごく小さな音もはっきりと記録できるということでもあります。

余談になりますが、オーディオにおけるパワーアンプの動作には A級とか B級、AB級というものがありますが、A級の方が音は良いものの消費電力が大きいです。

オーディオ信号を扱う素子は入力信号が - から + に変化ればその通りに増幅するように思えるかもしれませんが、+ と - の境目付近では信号を直線的に扱うことができず、いわば波形が鈍ってしまいます。

直線を直線として出力できないわけで、これをリニアリティが悪い、と言います。

A級のアンプというのは常に電流を流しておいて、常時 + の領域で信号を扱うようにしたものです。

こうすれば境目の領域を使うことがないので音質が良くなりますが、信号がない時でも電流を流しているので消費電力も発熱も大きくなります。

ビット数やサンプリング周波数を上げればデータ量は飛躍的に増加するので、今でこそハイレゾのデータを扱うことができますが、当時の機器の性能からすれば 44.1kHz、16bit としたのはぎりぎりの性能を追求したものと言えるのかもしれません。

人の耳は音叉の音のような純粋な音は確かに 20kHz 以上は聴き取ることはできませんが、音が変化する時は変化したということは感じ取れます。

また、波形が音色の変化となって現れる時にはそれも感じ取ることができます。

人の感覚はとても不思議です。

コメント 0